تسريب بيانات الذكاء الاصطناعي أصبح تحدياً حقيقياً مع انتشار وكلاء AI داخل الشركات، وهذه النظرة توضح المخاطر وكيفية التدقيق لحماية البيانات.

ما المقصود بوكلاء الذكاء الاصطناعي في الشركات؟

الوكيل الذكي ليس مجرد روبوت محادثة؛ بل نظام ينفّذ مهاماً تلقائية مثل إرسال البريد، نقل الملفات، أو إدارة التطبيقات. هذا التحول يسرّع العمل، لكنه يضيف مستخدماً رقمياً جديداً داخل الشبكة.

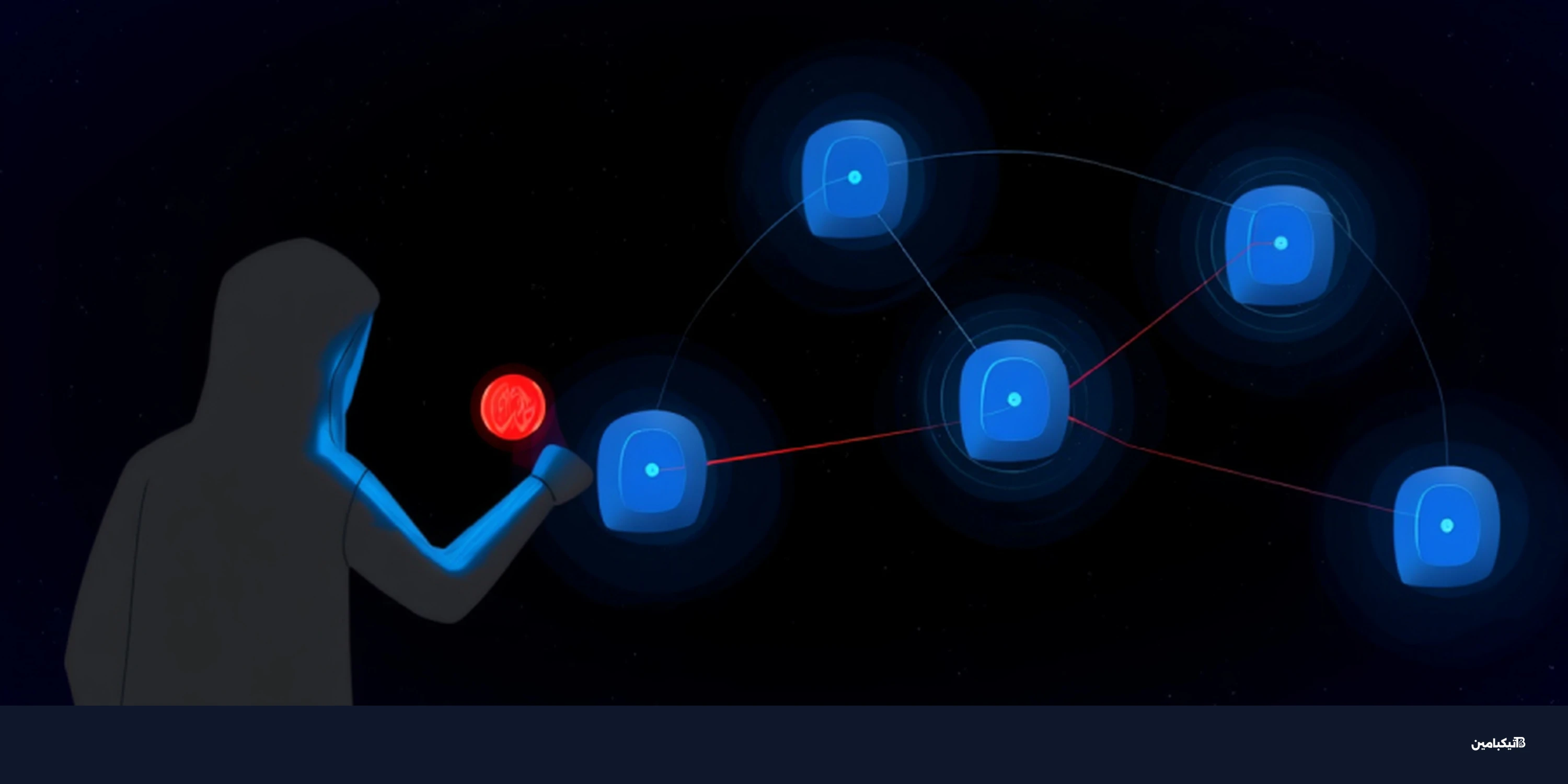

توضح تقارير تقنية حديثة أن الوكيل قد يمتلك صلاحيات تتجاوز الموظف العادي، لأنّه يحتاج الوصول إلى قواعد بيانات وأدوات تشغيل متعددة. هنا تبدأ المشكلة عندما لا يكون لهذا “الموظف” هوية واضحة أو رقابة مستمرة.

لماذا يوصف بالموظف غير المرئي؟

الوكلاء يعملون بصمت وبشكل متواصل، ما يجعل تتبع قراراتهم أصعب من تتبع تصرفات الموظفين البشر. وفقاً لمتابعة تيكبامين، المشكلة ليست في الذكاء نفسه، بل في اتساع الصلاحيات وسرعة التنفيذ.

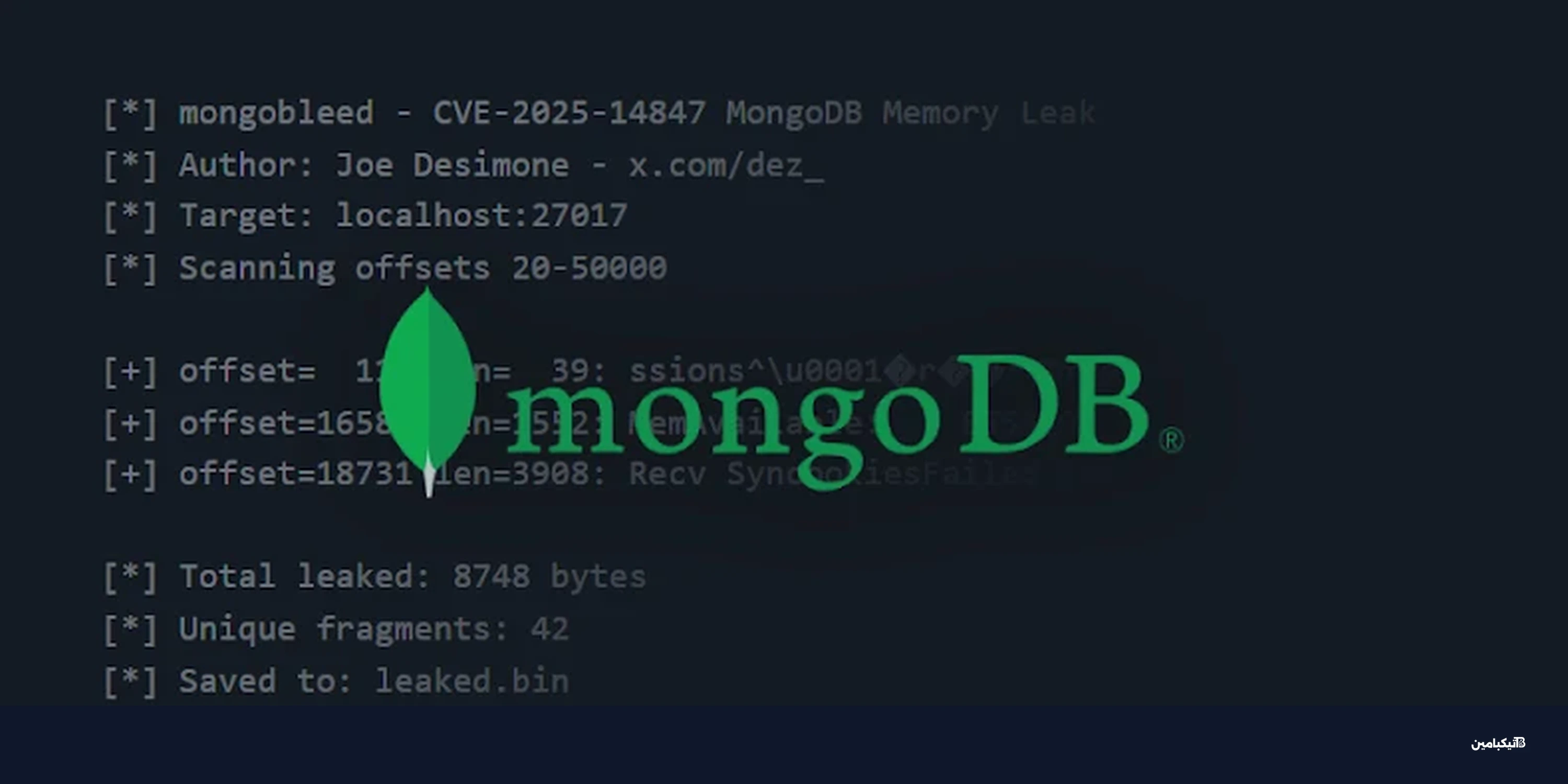

كيف يؤدي تسريب بيانات الذكاء الاصطناعي إلى ثغرات جديدة؟

تسريب بيانات الذكاء الاصطناعي لا يحدث فقط عبر الاختراق المباشر، بل عبر خداع الوكيل ليُنفّذ طلباً ضاراً. المهاجم لا يحتاج كلمة مرور، بل يحتاج “أمراً مقنعاً”.

أبرز مسارات الخطر التي ترصدها المؤسسات

- أوامر خبيثة تُمرّر داخل المحادثات أو ملفات العمل.

- صلاحيات واسعة على البريد والملفات المشتركة.

- نقل بيانات حساسة إلى أدوات خارجية دون مراجعة.

- غياب سجل واضح يُظهر من طلب ماذا ومتى.

هذه الثغرات تزيد مع اعتماد الشركات على أتمتة العمليات، خصوصاً في فرق المبيعات والدعم وخدمات العملاء.

كيف تراجع المؤسسات صلاحيات الوكلاء الرقميين؟

الحل يبدأ بتدقيق الوصول وليس بإيقاف الأتمتة. الشركات التي تتعامل بذكاء تراجع الصلاحيات كل 90 يوماً، وتحدّد ما يحتاجه الوكيل فعلاً دون زيادة.

خطوات عملية لتقليل المخاطر

- تقسيم الصلاحيات بحسب المهمة بدل الصلاحية الشاملة.

- تفعيل سجل تدقيق يوضح كل إجراء يقوم به الوكيل.

- إضافة طبقة موافقة بشرية للعمليات الحساسة.

- اختبار سيناريوهات “الأوامر المضللة” بشكل دوري.

كما ينصح خبراء الأمن بإضافة سياسات واضحة للتعامل مع البيانات الحساسة، خاصة في القطاعات المالية والصحية.

ماذا ستتناول الندوة حول أمن الوكلاء؟

تركز الندوات المتخصصة على كيفية بناء إطار أمني جديد للوكلاء، يشبه إدارة هوية المستخدم لكن بمتطلبات أكثر صرامة. الهدف هو سد الفجوة بين سرعة الذكاء الاصطناعي وحساسية البيانات.

محاور متوقعة للنقاش

- كيف يوسّع الوكيل سطح الهجوم داخل الشركة.

- طرق قياس المخاطر قبل تشغيل الوكيل على نطاق واسع.

- أمثلة واقعية لسيناريوهات استغلال متقدمة.

- خطط استجابة سريعة عند الاشتباه في تسريب.

هذه المحاور تساعد فرق IT والمديرين التنفيذيين على بناء قرارات مدروسة بدل الاعتماد على الافتراضات.

هل يمكن السيطرة على تسريب بيانات الذكاء الاصطناعي؟

الخبر الجيد أن تسريب بيانات الذكاء الاصطناعي يمكن تقليله بوضوح عند تطبيق سياسات هوية دقيقة ومراقبة مستمرة. يرى فريق تيكبامين أن الجمع بين الأتمتة والحوكمة هو الطريق الآمن للاستفادة دون مخاطر.

الرسالة الأساسية: لا تجعل الوكيل الذكي يعمل دون إشراف، ولا تمنحه مفاتيح أكثر مما يحتاج. بهذه الخطوات، يصبح الذكاء الاصطناعي قيمة مضافة بدلاً من ثغرة أمنية.