صرحت شركة أنثروبيك بتعرض نموذجها للذكاء الاصطناعي "كلود" لعمليات سرقة بيانات واسعة النطاق من قبل ثلاث شركات صينية أبرزها ديب سيك. تهدف هذه الحملة إلى تحسين النماذج الصينية عبر طرق استخراج غير مشروعة.

كشفت التحقيقات عن توليد أكثر من 16 مليون استعلام باستخدام حوالي 24 ألف حساب احتيالي ومزيف. يمثل هذا النشاط خرقاً صريحاً لشروط الخدمة، وتجاوزاً لقيود الوصول الإقليمية المفروضة على الصين بسبب المخاطر التنظيمية والأمنية.

كيف تمت سرقة قدرات نموذج كلود للذكاء الاصطناعي؟

حددت أنثروبيك الشركات المتورطة في هذه الحملات وهي DeepSeek، و Moonshot AI، و MiniMax. وقد اعتمدت هذه الشركات على تقنيات استخراج معقدة لنسخ قدرات نموذج كلود المتقدمة بكسر بسيط من التكلفة والوقت اللازمين لتطويرها داخلياً.

تمت هذه العمليات عبر هجمات موجهة، ونجحت أنثروبيك في تتبع كل حملة وربطها بمختبر ذكاء اصطناعي محدد. تم ذلك من خلال تحليل البيانات الوصفية للطلبات، وتتبع عناوين IP، ومراقبة مؤشرات البنية التحتية.

ما هي تقنية تقطير النماذج (Distillation)؟

تشير تقنية "التقطير" إلى تدريب نموذج ذكاء اصطناعي أقل كفاءة على المخرجات التي يولدها نظام أقوى وأكثر تطوراً. تعتبر هذه الطريقة شرعية فقط عندما تستخدمها الشركات داخلياً لتطوير نسخ مصغرة من نماذجها الخاصة.

لكن يصبح الأمر غير قانوني عندما يستخدمه المنافسون لسرقة قدرات النماذج الأخرى. وقد ركزت الهجمات الصينية على استخراج قدرات محددة من نموذج كلود، وتشمل:

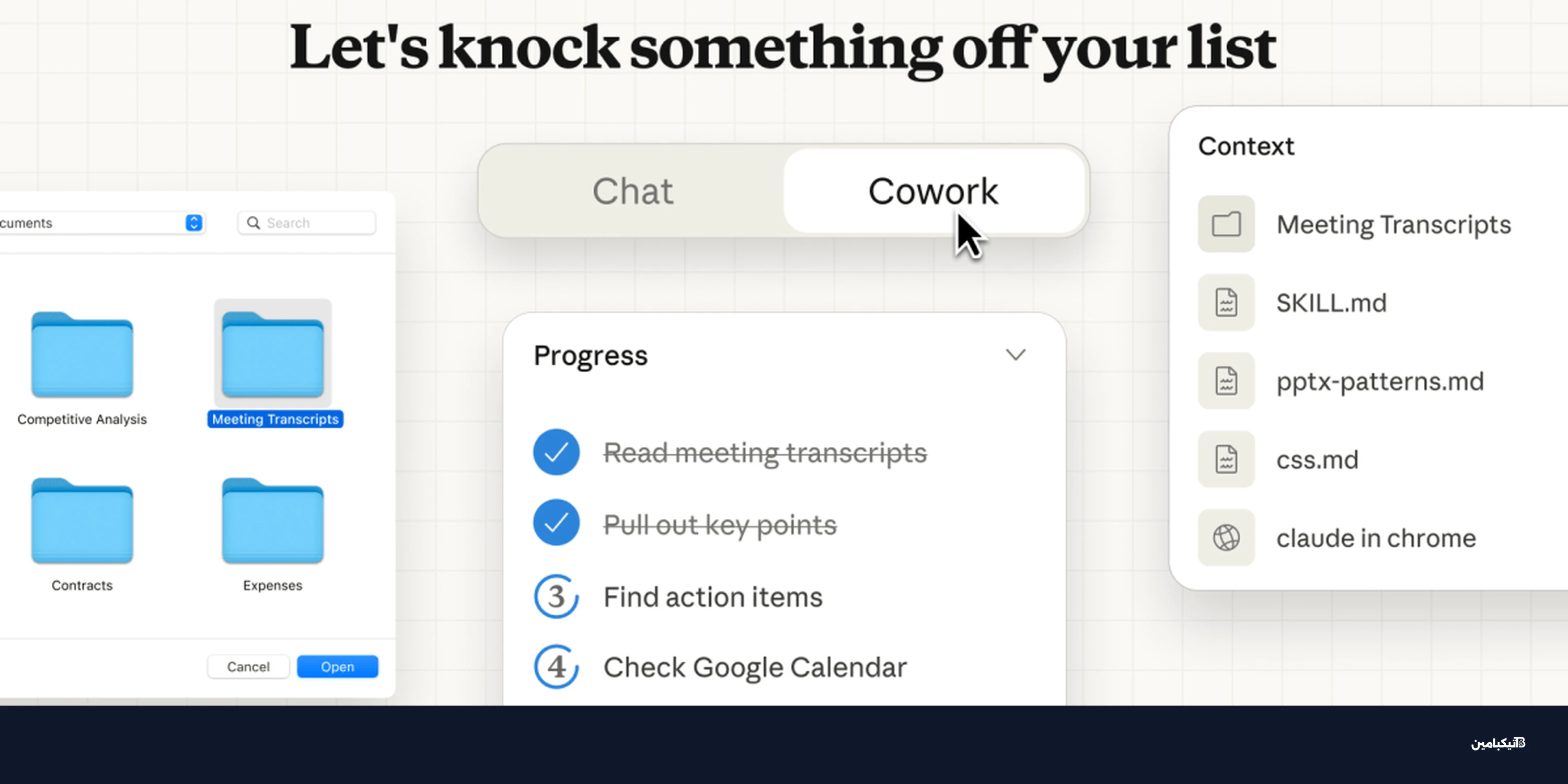

- الاستنتاج والتفكير الوكيلي (Agentic reasoning).

- القدرة المتقدمة على استخدام الأدوات البرمجية.

- كتابة وتحليل الأكواد البرمجية المعقدة (Coding).

وأكدت أنثروبيك أن حجم وهيكل الأوامر (Prompts) المستخدمة كان مختلفاً تماماً عن أنماط الاستخدام الطبيعي. وهذا يعكس نية واضحة ومدروسة لاستخراج القدرات بدلاً من الاستخدام المشروع.

كيف تجاوزت الشركات الصينية الحظر الإقليمي؟

أشارت التقارير إلى اعتماد المهاجمين على خدمات وكيل (Proxy) تجارية تعيد بيع الوصول إلى نماذج الذكاء الاصطناعي. تعمل هذه الخدمات عبر بنى تحتية معقدة تُعرف باسم "عناقيد الهيدرا" (Hydra clusters).

وكما توضح تحليلات منصة تيكبامين، فإن هذه الشبكات تعتمد على عدد هائل من الحسابات الوهمية. يساعد ذلك في توزيع حركة المرور عبر واجهة برمجة التطبيقات (API) لتجنب الاكتشاف والحظر الآلي.

ما هي المخاطر الأمنية لسرقة نماذج الذكاء الاصطناعي؟

حذرت أنثروبيك من أن النماذج المستنسخة بطرق غير شرعية تفتقر إلى الضمانات الأمنية الضرورية. ويؤدي انتشار هذه النماذج المفتقرة لقيود الأمان إلى مخاطر جسيمة على الأمن القومي العالمي.

يمكن توظيف هذه القدرات غير المحمية في تسهيل الأنشطة الخبيثة والهجمات السيبرانية. وتشمل أبرز التهديدات المحتملة وفقاً لمتابعة تيكبامين لتطورات الذكاء الاصطناعي ما يلي:

- دعم أنظمة التجسس والمراقبة الجماعية التي تديرها الحكومات.

- شن حملات تضليل إعلامي واسعة النطاق وبدقة عالية.

- تطوير برمجيات خبيثة تُستخدم في العمليات السيبرانية الهجومية العسكرية.