لم تعد مهام وكلاء الذكاء الاصطناعي (Agentic AI) مقتصرة على كتابة الأكواد البرمجية فحسب، بل تجاوزت ذلك لتنفيذها فعلياً، مما يفتح باباً واسعاً لمخاطر أمنية جديدة قد تغفل عنها الفرق الهندسية وتؤدي لثغرات حرجة.

مع صعود أدوات متطورة مثل Copilot و Claude Code، أصبح بإمكان المطورين بناء واختبار ونشر البرمجيات بشكل كامل وفي دقائق معدودة. ورغم أن هذه السرعة تعيد تشكيل مستقبل الهندسة البرمجية، إلا أن تقارير تيكبامين تشير إلى أنها تخلق فجوة أمنية لا تكتشفها معظم الفرق إلا بعد فوات الأوان.

ما هي بروتوكولات التحكم في الآلة (MCPs)؟

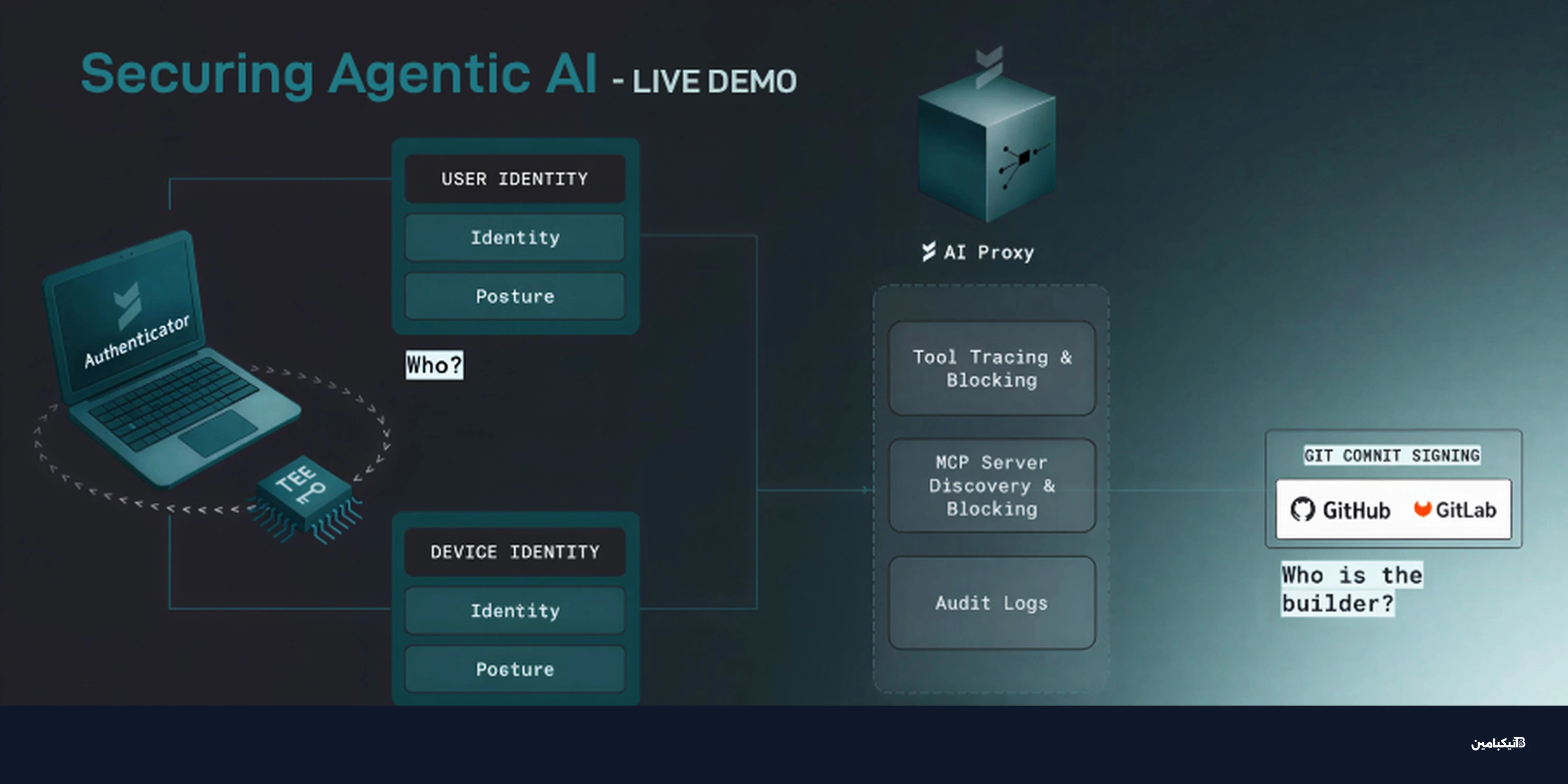

خلف كل سير عمل للذكاء الاصطناعي الوكيل، توجد طبقة نادراً ما تقوم المؤسسات بتأمينها بشكل نشط، وهي ما يُعرف ببروتوكولات التحكم في الآلة (MCPs). هذه الأنظمة هي العقل المدبر الذي يقرر بهدوء الصلاحيات الممنوحة للذكاء الاصطناعي.

تتحكم هذه البروتوكولات في العناصر التالية:

- الأوامر التي يمكن للوكيل تشغيلها.

- الأدوات البرمجية التي يُسمح له باستدعائها.

- واجهات برمجة التطبيقات (APIs) التي يمكنه الوصول إليها.

- البنية التحتية التي يُسمح له بالتعديل عليها.

يكمن الخطر الحقيقي في أنه بمجرد اختراق مستوى التحكم هذا أو تكوينه بشكل خاطئ، لا يكتفي الوكيل بارتكاب الأخطاء فحسب، بل يبدأ في التصرف بسلطة كاملة قد تضر بالنظام.

كيف تحولت الثغرة CVE-2025-6514 إلى درس قاسٍ؟

لإدراك حجم المخاطر، يمكننا النظر إلى ما حدث مع الثغرة الأمنية CVE-2025-6514. في تلك الحادثة، تحول وكيل OAuth موثوق، يعتمد عليه أكثر من 500,000 مطور، إلى مسار لتنفيذ التعليمات البرمجية عن بعد (RCE).

لم يتطلب الأمر سلسلة استغلال معقدة أو اختراقاً صاخباً، بل كان مجرد أتمتة تقوم بما سُمح لها بفعله بالضبط، ولكن على نطاق واسع وغير منضبط. هذه الحادثة أوضحت حقيقة مرعبة: إذا كان بإمكان وكيل الذكاء الاصطناعي تنفيذ الأوامر، فإنه يملك القدرة أيضاً على تنفيذ الهجمات.

يوصي خبراء الأمن بضرورة التحرك السريع لفهم المخاطر الأساسية التي ترثها فرق الأمن من تبني الذكاء الاصطناعي الوكيل.

ما هي ظاهرة انتشار مفاتيح API الخفية؟

أحد أكبر التحديات التي تواجه المؤسسات اليوم هو كيفية التعامل مع ما يسمى بـ "Shadow API Key Sprawl" أو انتشار مفاتيح الوصول الخفية. حيث تظهر هذه المفاتيح في أماكن غير متوقعة، وتتوسع الأذونات بهدوء دون رقابة مركزية.

وفقاً لمتابعات تيكبامين، فإن نماذج الهوية والوصول التقليدية تنهار عندما يبدأ الوكلاء في التصرف نيابة عن البشر، مما يستوجب استراتيجيات أمنية جديدة تشمل:

- فهم كيفية عمل خوادم MCP في البيئات الحقيقية.

- تحديد أماكن ظهور مفاتيح API غير المدارة.

- مراقبة توسع الصلاحيات والأذونات بشكل دوري.

أصبح الذكاء الاصطناعي الوكيل موجوداً بالفعل داخل خطوط الأنابيب (Pipelines) الخاصة بالشركات. والسؤال الوحيد المتبقي هو ما إذا كانت فرق الأمن قادرة على رؤية ما يفعله هذا الذكاء، وإيقافه عندما يتجاوز الحدود المسموحة قبل وقوع الحادثة التالية.