يكشف تقرير تيكبامين سر فشل تطبيقات الذكاء الاصطناعي بعد العرض التجريبي، حيث تظهر فجوة كبيرة بين الوعود التقنية والواقع التشغيلي في بيئات العمل.

تعتبر العروض التجريبية أسرع وسيلة للوقوع في حب أي أداة من أدوات الذكاء الاصطناعي؛ فكل شيء يتحرك بسرعة، والنتائج تظهر بدقة مذهلة في ثوانٍ معدودة. يشعر الفريق للوهلة الأولى أنها بداية عصر جديد من الإنتاجية، لكن سرعان ما يصطدم هذا التفاؤل بالواقع المرير عند محاولة تطبيق هذه التقنيات على نطاق واسع.

الحقيقة هي أن معظم مبادرات الذكاء الاصطناعي لا تفشل بسبب ضعف التكنولوجيا نفسها، بل لأن ما ينجح في العروض التوضيحية (Demos) غالباً ما يفشل في الصمود أمام تعقيدات العمليات الحقيقية. الفجوة بين البيئة التجريبية المحكومة والواقع التشغيلي اليومي هي المكان الذي تبدأ فيه المشاكل الحقيقية للشركات.

لماذا تبدو عروض الذكاء الاصطناعي مثالية ومضللة؟

تصمم أغلب عروض منتجات الذكاء الاصطناعي لإبراز الإمكانات القصوى وتجاهل الاحتكاك الناتج عن المشاكل التقنية. تعتمد هذه العروض عادةً على العناصر التالية:

- بيانات نظيفة ومنظمة بدقة عالية.

- مدخلات متوقعة وسيناريوهات محددة مسبقاً.

- مطالبات (Prompts) تمت صياغتها بعناية فائقة.

- حالات استخدام بسيطة ومفهومة تماماً.

وفقاً لتقرير تيكبامين، فإن بيئات الإنتاج الحقيقية لا تشبه هذه العروض في شيء؛ فالبيانات تكون مشوشة، والأنظمة مجزأة، والسياق غالباً ما يكون ناقصاً. هنا يبدأ التباطؤ، ويتحول الحماس الأولي إلى حالة من الإحباط بمجرد محاولة نشر التقنية خارج المختبر.

ما هي أبرز العقبات التي تواجه الذكاء الاصطناعي في الإنتاج؟

عند الانتقال من مرحلة العرض إلى مرحلة النشر الفعلي، تظهر مجموعة من التحديات الجوهرية التي تعيق نجاح تطبيقات الذكاء الاصطناعي:

- جودة البيانات: في بيئات الأمن وتقنية المعلومات، تتوزع البيانات عبر أدوات متعددة وبتنسيقات متباينة، مما يربك النماذج التي اعتادت على البيانات النظيفة.

- مشكلة التأخير (Latency): النموذج الذي يبدو سريعاً في تجربة منعزلة قد يتسبب في تأخيرات قاتلة عند دمجه في سير عمل معقد يتطلب سرعة فائقة.

- الحالات الاستثنائية (Edge Cases): تشمل تدفقات العمل الواقعية آلاف الاستثناءات والسلوكيات غير المتوقعة التي قد تؤدي إلى انهيار النظام تماماً.

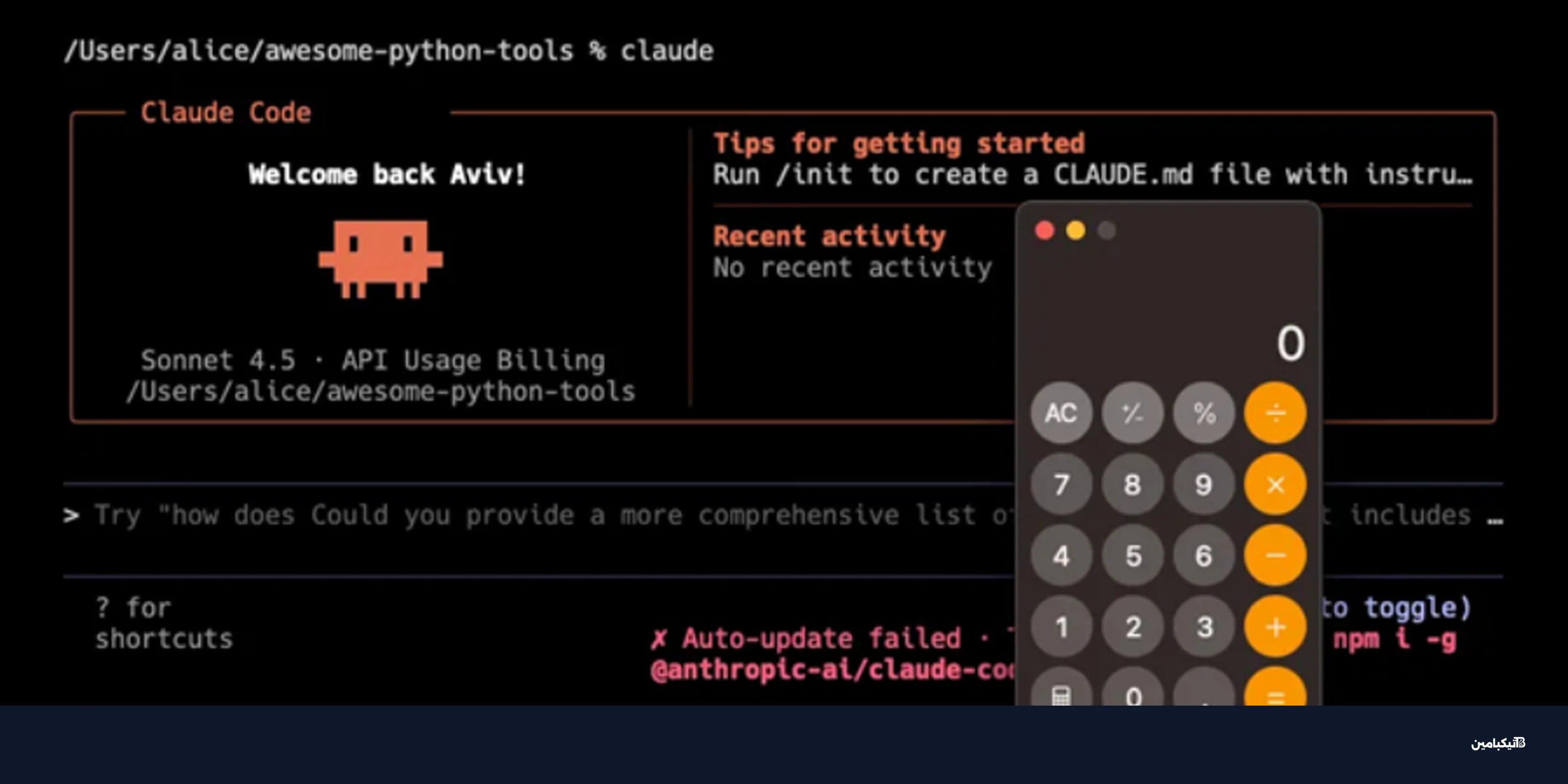

- تحديات التكامل: يتطلب العمل التشغيلي تنسيقاً عميقاً بين أنظمة مختلفة؛ فإذا لم تستطع أداة الذكاء الاصطناعي الاتصال بهذه الأنظمة، سيظل تأثيرها محدوداً مهما كانت قوتها.

الحوكمة: النقطة التي يتوقف عندها الحماس

بعيداً عن العقبات التقنية، أصبحت الحوكمة هي السبب الأكبر وراء تعثر مشاريع الذكاء الاصطناعي. ومع سهولة الوصول إلى الأدوات العامة، تواجه المؤسسات أسئلة صعبة تتعلق بخصوصية البيانات والامتثال للقوانين.

اكتشفت العديد من الفرق أن تجربة الذكاء الاصطناعي سهلة، لكن تشغيله بشكل آمن يتطلب سياسات وضوابط صارمة. وبدون هذه الضوابط، تظل حتى المبادرات الواعدة عالقة في دوامة المراجعات القانونية التي لا تنتهي.

في نهاية المطاف، عندما يتم تطبيق الحوكمة كإطار عمل استراتيجي، فإنها تساعد الفرق على التحرك بثقة وسرعة، مما يضمن أن تطبيقات الذكاء الاصطناعي لن تكتفي بالنجاح في العرض التجريبي فحسب، بل ستصبح جزءاً لا يتجزأ من نجاح المؤسسة المستقبلي.