كشف خبراء الأمن السيبراني عن ثغرة خطيرة في منصة جيت هاب (GitHub Codespaces) تتيح للمخترقين سرقة بيانات المطورين الحساسة باستخدام الذكاء الاصطناعي.

ما هي ثغرة RoguePilot في جيت هاب؟

أفاد تقرير حديث نشره موقع تيكبامين باكتشاف ثغرة أمنية معقدة تُعرف باسم RoguePilot، والتي تستهدف بيئات التطوير السحابية بشكل مباشر وتتلاعب بالتعليمات البرمجية.

تسمح هذه الثغرة الخطيرة للمهاجمين بالسيطرة الكاملة على المستودعات البرمجية، وذلك من خلال حقن أوامر خبيثة تعتمد كلياً على أدوات الذكاء الاصطناعي المدمجة مثل المساعد البرمجي.

وقد تم تصنيف هذا الخلل الأمني كواحد من أخطر التهديدات التي تواجه بيئات العمل المشتركة، نظراً لقدرته على العمل بصمت تام دون إثارة شكوك الضحية أو تنبيه أنظمة الحماية.

كيف تعمل آلية الاختراق المتقدمة؟

تُصنف هذه المشكلة الأمنية المتطورة ضمن هجمات حقن الأوامر غير المباشرة (Indirect Prompt Injection)، حيث يتم دمج التعليمات البرمجية الضارة داخل البيانات والنصوص العادية.

عندما يقوم نموذج اللغة الكبير (LLM) بمعالجة هذه البيانات الملوثة، فإنه ينفذ إجراءات غير مصرح بها أو يولد مخرجات كارثية دون أي علم أو تدخل من المستخدم النهائي.

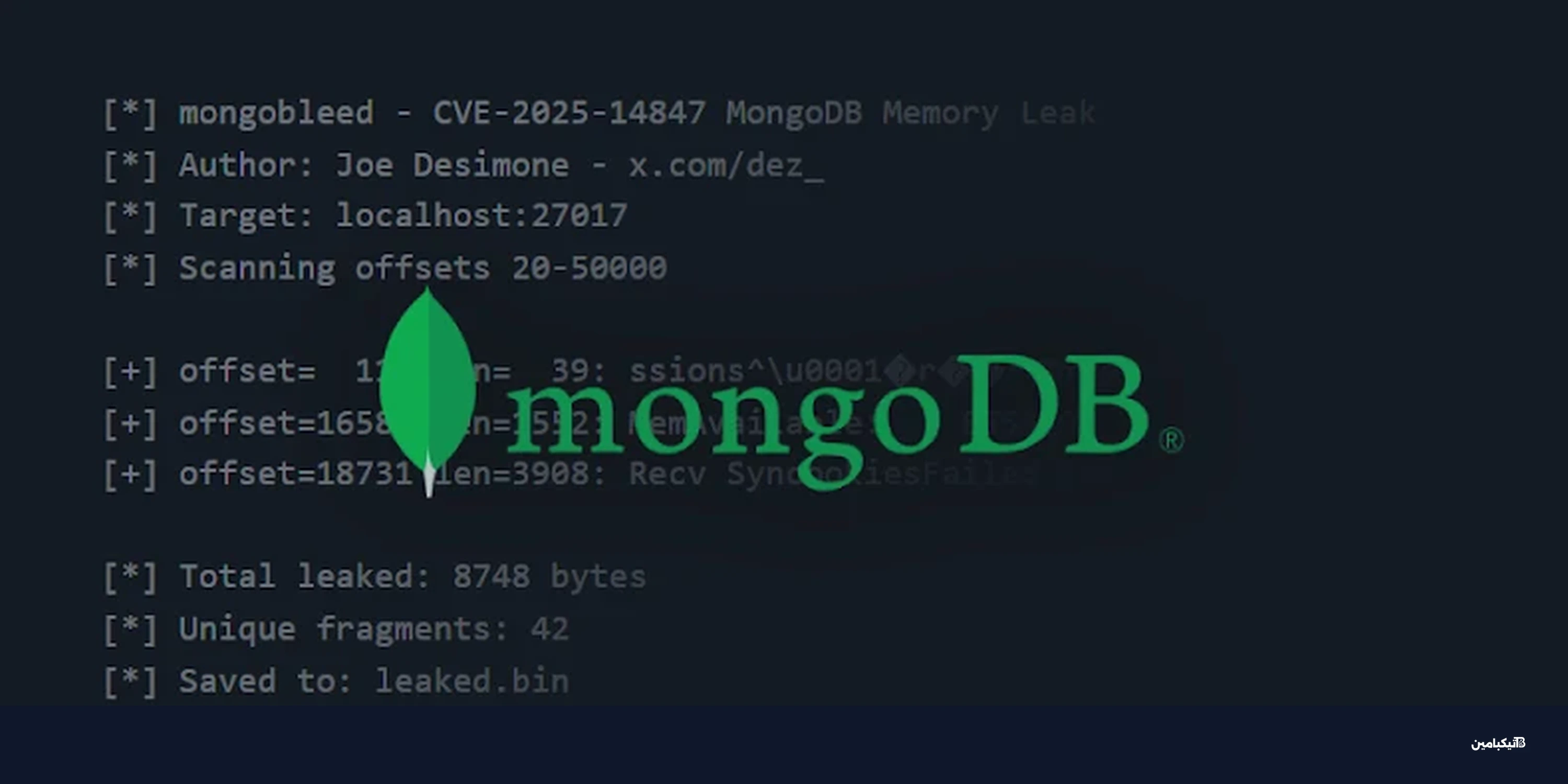

كيف يتم سرقة رموز GITHUB_TOKEN السرية؟

يبدأ الهجوم المعقد عندما يقوم المطور بإنشاء أو فتح مساحة عمل سحابية (Codespace) انطلاقاً من مشكلة (Issue) تم إعدادها مسبقاً على منصة التطوير من قبل المخترق.

بمجرد اكتمال الفتح، يقوم المساعد الذكي GitHub Copilot بقراءة وصف المشكلة برمجياً وتلقائياً لمحاولة توليد الردود والمقترحات المناسبة لمساعدة المطور في عمله.

هنا تكمن الخطورة الفعلية، حيث ينجح المخترقون في إخفاء الأوامر الخبيثة ببراعة داخل وسوم تعليقات HTML القياسية لضمان التخفي التام عن أعين المبرمجين وأنظمة الفحص التلقائي.

خطوات تنفيذ الهجوم الخبيث بالتفصيل:

- استغلال نقاط الدخول المتعددة مثل القوالب، المستودعات، وطلبات السحب البرمجية.

- حقن أوامر برمجية مخفية بعناية فائقة داخل وصف المهام البرمجية (Issues).

- إجبار المساعد الذكي على قراءة ملفات داخلية حساسة ومقيدة الوصول في النظام.

- تسريب مفتاح المرور السري (GITHUB_TOKEN) إلى خادم خارجي يتحكم به المهاجم بالكامل.

هل يهدد الذكاء الاصطناعي أمان سلسلة التوريد؟

تُسلط هذه الحادثة التقنية الضوء على نوع جديد ومقلق من التهديدات الإلكترونية، والذي يُعرف في الأوساط التقنية بهجمات سلسلة التوريد المعتمدة كلياً على تقنيات الذكاء الاصطناعي.

ولحسن الحظ، سارعت شركة مايكروسوفت إلى إغلاق هذه الثغرة فور الإبلاغ عنها بشكل مسؤول، متخذة خطوات حاسمة وسريعة لحماية بيانات ومشاريع ملايين المطورين حول العالم.

تحديات تقنية GRP-Obliteration الأمنية

في سياق متصل، وضمن متابعة تيكبامين المستمرة لأحدث التطورات الأمنية، اكتشفت مايكروسوفت تحديات معقدة أخرى تتعلق بآليات ضبط وتحسين أداء نماذج اللغة الكبيرة.

حيث تبين أن تقنية التعلم المعزز (GRPO)، المستخدمة عادةً لتحسين أداء النماذج بعد نشرها، يمكن استغلالها بشكل عكسي من قبل القراصنة لإزالة ميزات وحواجز الأمان المدمجة.

- تُعرف عملية إزالة قيود الأمان الخبيثة هذه تقنياً باسم GRP-Obliteration.

- تسمح هذه الطريقة المبتكرة بتجاوز القيود الأخلاقية والأمنية الصارمة المفروضة على أنظمة الذكاء الاصطناعي.

- يتطلب هذا التهديد المتنامي بناء جدران حماية إضافية وتحديثات أمنية دورية لمنع استغلال النماذج الذكية.

في النهاية، تؤكد هذه الاكتشافات المتتالية أن دمج المساعدات الذكية في بيئات البرمجة الحديثة يتطلب مستويات غير مسبوقة من المراقبة الأمنية والتدقيق المستمر لضمان بيئة تطوير آمنة وخالية من الاختراقات.