كشف تقرير جديد عن تصاعد التحديات الأمنية مع انتشار الذكاء الاصطناعي في المؤسسات، حيث يجد مسؤولو الأمن السيبراني أنفسهم يواجهون تهديدات حديثة بأدوات ومهارات تقليدية غير كافية.

وفقاً لتقرير Pentera Benchmark 2026، يعاني 67% من قادة الأمن من محدودية الرؤية في كيفية استخدام الذكاء الاصطناعي داخل مؤسساتهم.

لماذا يعاني خبراء الأمن من حماية أنظمة الذكاء الاصطناعي؟

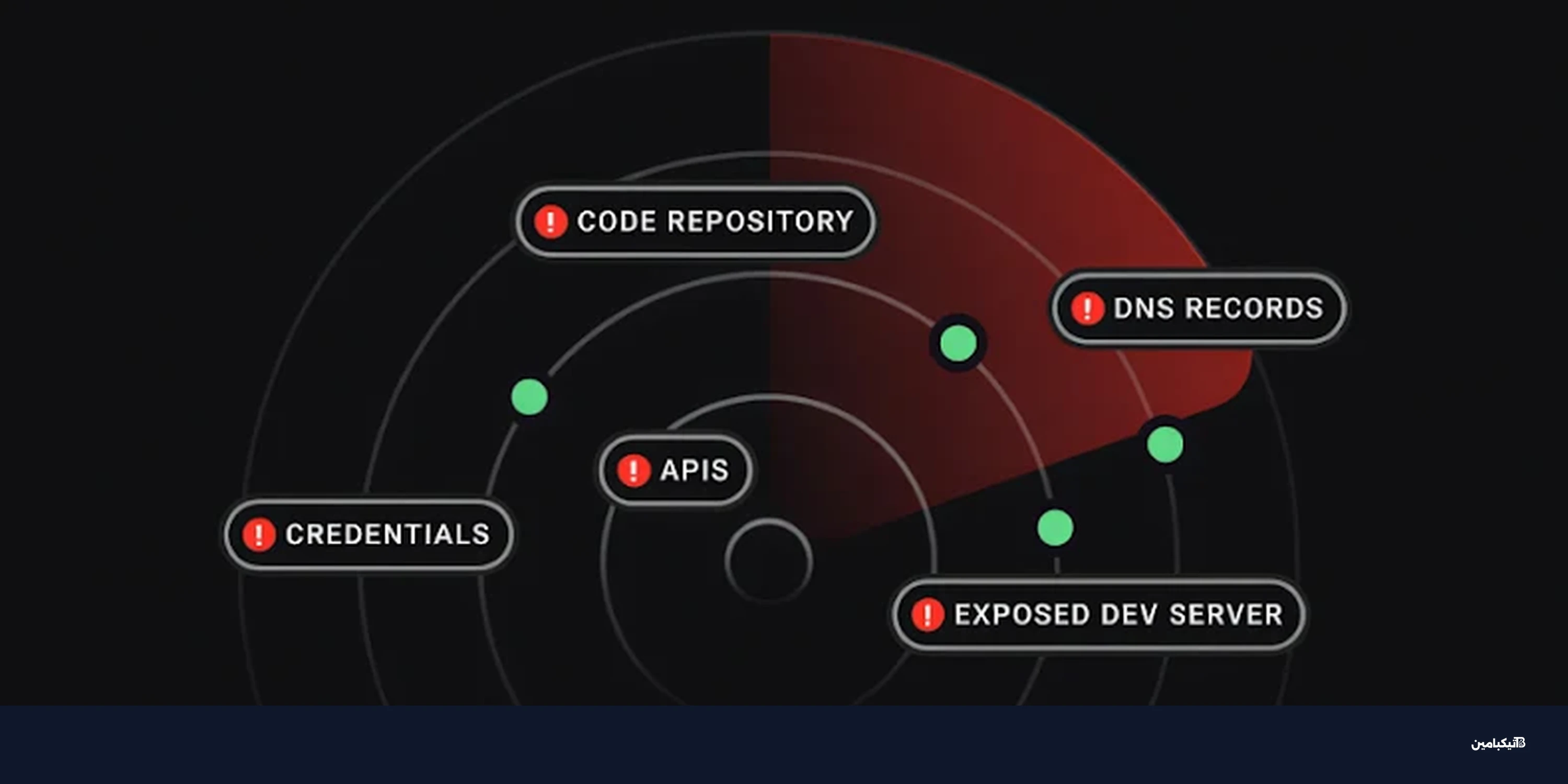

أنظمة الذكاء الاصطناعي لا تعمل بمعزل عن غيرها، بل تتكامل مع البنية التحتية الحالية للمؤسسات، من المنصات السحابية إلى أنظمة الهوية وخطوط البيانات.

مع انتشار الملكية عبر فرق متباينة، انهارت الرقابة المركزية الفعالة. هذا الوضع يخلق فجوات أمنية خطيرة.

التحديات الرئيسية

- محدودية الرؤية الشاملة لأنظمة الذكاء الاصطناعي

- صعوبة تتبع الموارد التي يمكن للأنظمة الوصول إليها

- غياب الإجابات عن الأسئلة الأمنية الأساسية

هل المهارات أم الميزانية هي العقبة الأكبر؟

خلافاً للتوقعات، أظهرت الدراسة أن التحديات الرئيسية ليست مالية. فقط 17% من المشاركين ذكروا قيود الميزانية كقلق رئيسي.

تشير النتائج إلى أن العديد من المؤسسات مستعدة للاستثمار في أمن الذكاء الاصطناعي، لكنها تفتقر إلى المهارات المتخصصة اللازمة.

العقبات الرئيسية أمام أمن الذكاء الاصطناعي

- نقص المهارات المتخصصة في تقييم مخاطر الذكاء الاصطناعي

- الصعوبة في تقييم فعالية ضوابط الأمن الحالية

- الحاجة إلى خبرات في اتخاذ القرار المستقل للأنظمة

تتطلب أنظمة الذكاء الاصطناعي أساليب تقييم جديدة، حيث تقدم سلوكيات لا تزال فرق الأمن تتعلم كيفية تقييمها.

كيف تتعامل المؤسسات مع أمن الذكاء الاصطناعي؟

في غياب أفضل الممارسات والمهارات الخاصة بالذكاء الاصطناعي، تعتمد معظم المؤسسات على ضوابط الأمن الحالية.

وجدت الدراسة أن 75% من مسؤولي الأمن يعتمدون على ضوابط الأمن التقليدية لحماية أنظمة الذكاء الاصطناعي.

الاعتماد الحالي على أدوات الأمن

- 75% يعتمدون على ضوابط الأمن التقليدية

- 11% فقط لديهم أدوات أمن مصممة خصيصاً للذكاء الاصطناعي

- التركيز على أمن نقاط النهاية والتطبيقات والسحابة

يلاحظ تيكبامين أن هذا النهج يعكس نمطاً مألوفاً شهدناه مع التكنولوجيات السابقة، حيث يتم تطبيق ضوابط قديمة على تكنولوجيا جديدة.

التحديات المستقبلية

- الحاجة المستمرة لتطوير مهارات جديدة

- ضرورة تطوير أدوات أمنية مخصصة للذكاء الاصطناعي

- أهمية الاختبار النشط لتقييم فعالية الضوابط

مع استمرار تطور أنظمة الذكاء الاصطناعي، تحتاج المؤسسات إلى الاستثمار في تطوير المهارات المتخصصة وتبني أدوات أمنية مصممة خصيصاً لهذه التكنولوجيا المتقدمة.