مع انتشار المحتوى المولد عبر الذكاء الاصطناعي، تبرز تساؤلات حول جدية شركات التقنية الكبرى مثل ميتا في محاربة هذه الفوضى على منصاتها.

في نهاية عام 2025، أعرب آدم موسيري، رئيس إنستغرام، عن قلقه المتزايد حيال تقنيات الذكاء الاصطناعي. وأشار إلى أن الأصالة أصبحت قابلة للاستنساخ بسهولة بفضل هذه الأدوات المتقدمة، وأن كل ما يميز صناع المحتوى أصبح متاحاً للجميع.

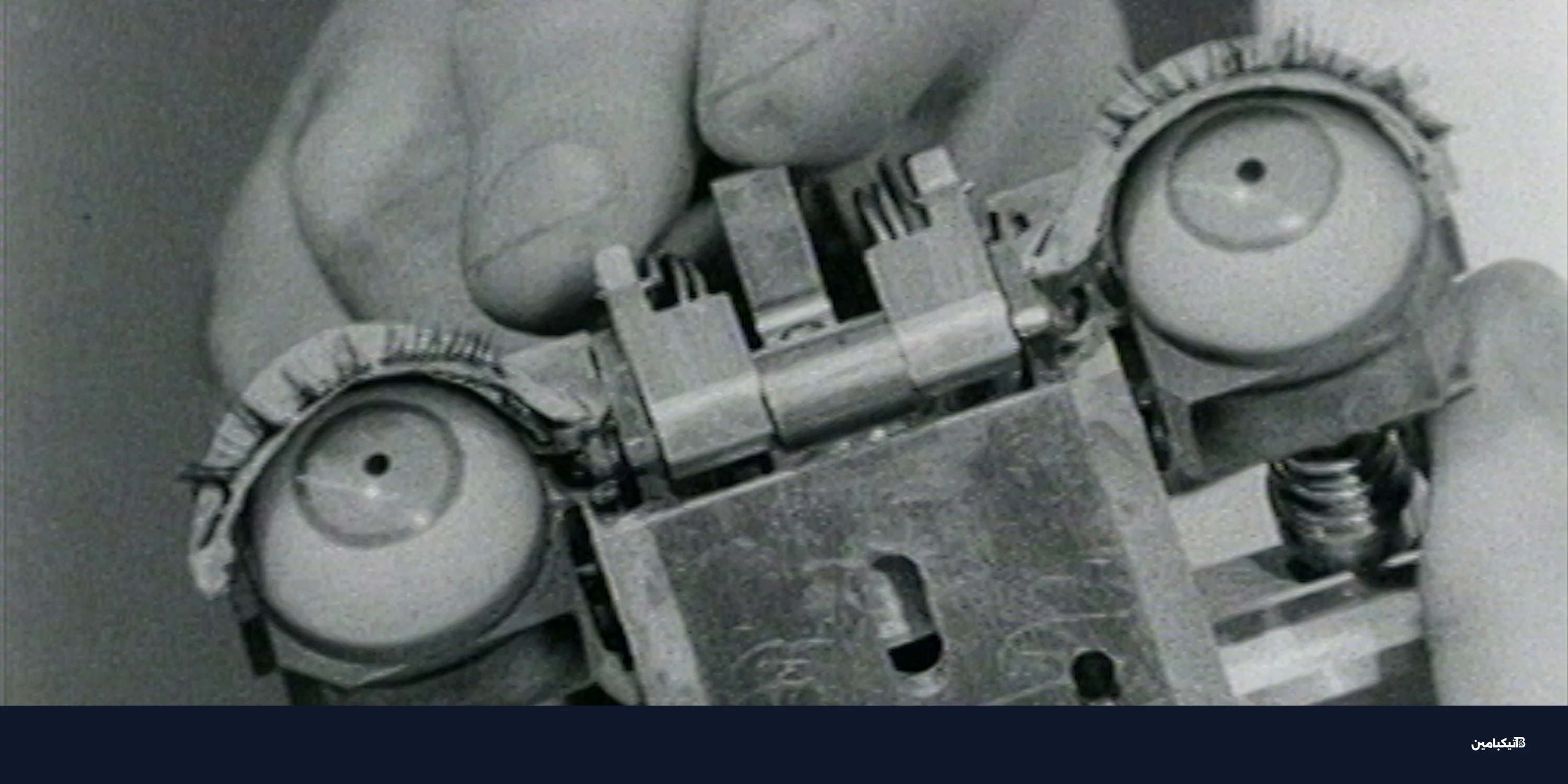

واقترح موسيري حلاً يعتمد على توقيع الصور تشفيرياً عند التقاطها عبر الكاميرات، لإنشاء نظام موثوق يميز المحتوى الحقيقي عن المزيف لتلبية رغبة الجمهور في متابعة محتوى أصلي.

ما هو معيار C2PA وهل يكفي لمواجهة الذكاء الاصطناعي؟

الخبر السار هو أن الحل الذي يقترحه موسيري موجود بالفعل ويُعرف باسم نظام C2PA. ومع ذلك، تشير تقارير تيكبامين إلى أن استخدام إنستغرام لهذا النظام لم يحل المشكلة جذرياً حتى الآن.

يبدو أن تبني هذا المعيار أصبح مجرد بديل لاتخاذ إجراءات صارمة وملموسة. ويأتي هذا في وقت تستمر فيه منصات ميتا في تسريع تطوير أدوات توليد المحتوى الخاصة بها دون قيود حقيقية.

كيف يهدد المحتوى المزيف صناع المحتوى؟

أصبحت التقنيات الحديثة بارعة جداً في محاكاة الواقع، مما يهدد الثقافة ونماذج العمل التي بنتها منصات التواصل الاجتماعي حول صناع المحتوى الحقيقيين.

ويمكن لهذه الأدوات المتقدمة تنفيذ العديد من المهام المعقدة، ومنها:

- نسخ الحركات وتوجهات الرقص الشائعة بدقة متناهية.

- إنشاء صور فوتوغرافية لشخصيات ومؤثرين ليس لهم وجود حقيقي.

- تكرار المحتوى النمطي الذي يملأ شبكات التواصل الاجتماعي بالفعل.

- نشر معلومات مضللة وصور مزيفة حول الأحداث الهامة بسرعة فائقة.

يحاول المبدعون محاربة هذا الاتجاه من خلال التركيز على الجماليات العفوية وغير المثالية، لكن الخوارزميات أصبحت تجيد تقليد هذه العفوية أيضاً.

ما هو تحالف أصالة المحتوى (C2PA) وكيف يعمل؟

خلال السنوات القليلة الماضية، حاولت أسماء كبيرة في عالم التقنية محاربة هذه الظاهرة من خلال تبني نظام بيانات الاعتماد، أو ما يُعرف بـ تحالف مصدر المحتوى وأصالته (C2PA).

تأسس هذا المعيار التقني المهم في عام 2021 بدعم من شركات كبرى تشمل:

- مايكروسوفت (Microsoft)

- إنتل (Intel)

- أدوبي (Adobe)

- آرم (ARM)

يعمل النظام من خلال إرفاق بيانات وصفية غير مرئية بالصور ومقاطع الفيديو والصوتيات لحظة إنشائها أو تعديلها. ويتيح ذلك للمستخدمين التحقق من هوية صانع المحتوى، ووقت وتاريخ الإنشاء، وما إذا كان قد تم استخدام الذكاء الاصطناعي في العملية.

دور ميتا ومستقبل المحتوى الرقمي

انضمت شركة ميتا إلى اللجنة التوجيهية لمعيار C2PA في سبتمبر 2024 لدعم هذا التوجه، مؤكدة أن فهم طبيعة المحتوى الرقمي أمر بالغ الأهمية للحفاظ على بيئة رقمية صحية وموثوقة.

ورغم دعم شركات ضخمة مثل جوجل وتيك توك وأوبن إيه آي لهذا النظام، إلا أنه يظل أداة واحدة ضمن معركة طويلة. وكما يرى فريق تيكبامين، فإن طريقة التنفيذ الحالية لا تبدو كافية لحماية المستخدمين العاديين من المحتوى المضلل وفوضى الذكاء الاصطناعي التي تجتاح الإنترنت اليوم.