في خطوة مفاجئة، أعلن العشرات من خبراء جوجل وأوبن إي آي دعمهم لشركة أنثروبيك في دعواها ضد البنتاغون، رافضين تصنيفها كخطر أمني.

قدم حوالي 40 موظفاً من شركتي جوجل (Google) وأوبن إي آي (OpenAI)، وعلى رأسهم جيف دين، كبير علماء جوجل وقائد تطوير نموذج جيميناي، مذكرة قانونية لدعم مسار أنثروبيك القضائي. وجاءت هذه الخطوة السريعة بعد ساعات قليلة من إعلان الشركة رفع دعوى ضد وزارة الدفاع الأمريكية.

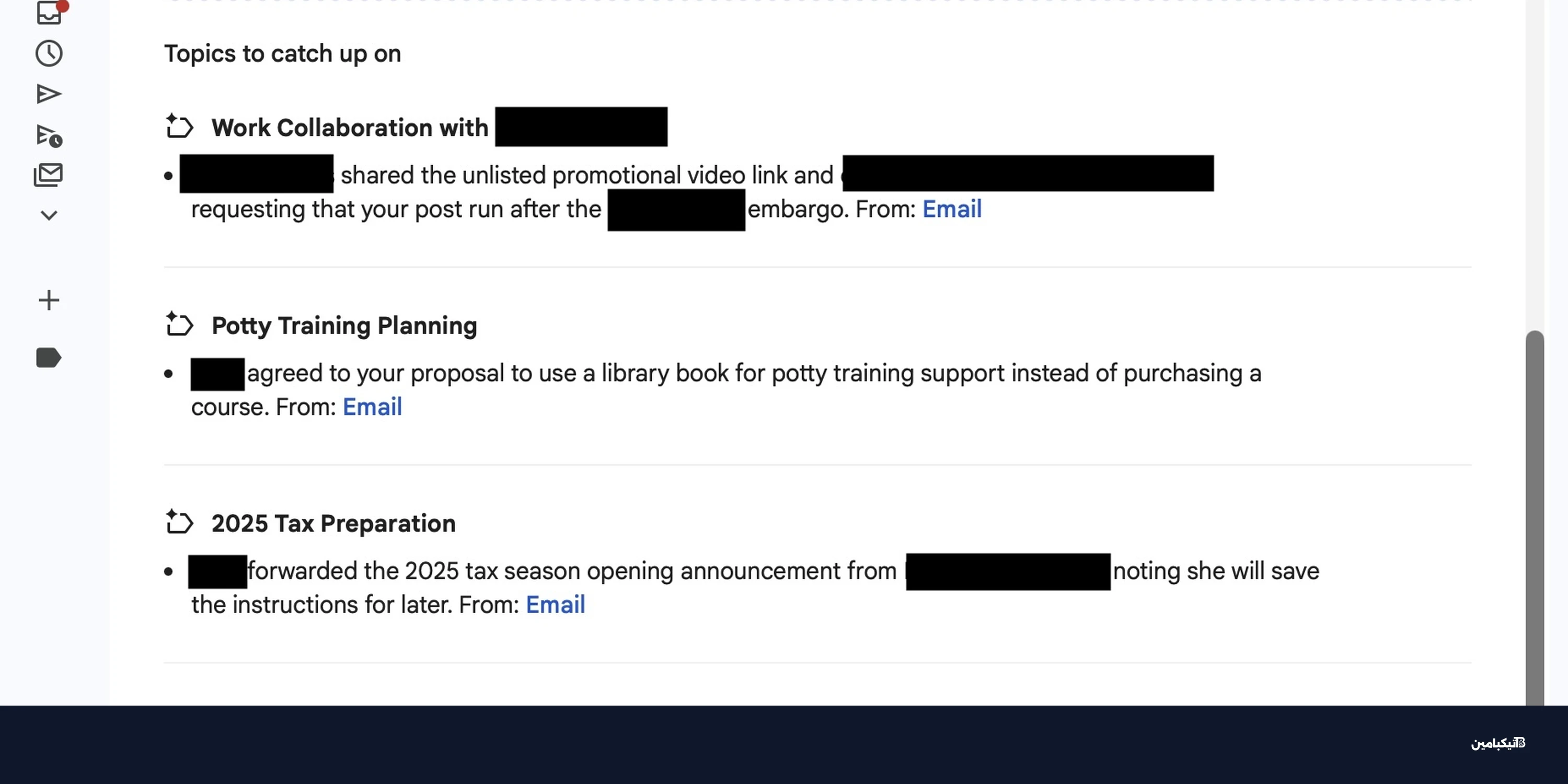

تفاصيل دعم الخبراء في قضية أنثروبيك

عبر الخبراء الموقعون على المذكرة عن قلقهم البالغ إزاء قرار الإدارة الأمريكية وتأثيراته السلبية. وأكدت المجموعة، التي تضم نخبة من المهندسين وعلماء الذكاء الاصطناعي، أنهم يتدخلون بصفاتهم الشخصية كمهنيين يدركون قدرات هذه الأنظمة ومخاطرها الحقيقية.

أهداف المذكرة القانونية

- اعتبار تصنيف أنثروبيك كخطر على سلسلة التوريد إجراءً انتقامياً يضر بالمصلحة العامة وتطور التكنولوجيا.

- التأكيد على أن المراقبة المحلية الجماعية المعتمدة على الذكاء الاصطناعي تهدد النظم الديمقراطية بشكل صريح.

- التنبيه إلى أن أنظمة الأسلحة الفتاكة والمستقلة تشكل مخاطر جسيمة يجب تنظيمها فوراً.

لماذا تم تصنيف أنثروبيك كخطر أمني؟

حسب متابعة تيكبامين، صدر هذا التصنيف الدراماتيكي بعد أن تمسكت الشركة المنتجة لنموذج (Claude) بمبادئها المتعلقة باستخدام تقنياتها في المجالات العسكرية. ويُعد هذا التصنيف نادراً للشركات الأمريكية، إذ يُستخدم عادة ضد الشركات الأجنبية التي تشكل تهديداً استراتيجياً للأمن القومي.

الخطوط الحمراء غير القابلة للتفاوض

رفضت الشركة بشكل قاطع السماح باستخدام نماذجها في تطبيقين رئيسيين:

- عمليات المراقبة الجماعية للمدنيين داخل البلاد.

- تطوير أسلحة مستقلة بالكامل تتخذ قرارات هجومية مميتة دون إشراف بشري مباشر.

ما هي تداعيات أزمة أنثروبيك والبنتاغون؟

أدى رفض الشركة لهذه الاستخدامات إلى انهيار المفاوضات مع الجيش الأمريكي وتصاعد التوترات العلنية، مما فتح الباب أمام شركات ذكاء اصطناعي منافسة للتدخل وتوقيع عقود عسكرية تسمح بأي استخدام قانوني لتقنياتها. ولا يقتصر تأثير التصنيف على منع الشركة من العقود المباشرة فحسب.

يضع هذا القرار أي شركة متعاقدة مع البنتاغون في القائمة السوداء إذا كانت تستخدم منتجات أنثروبيك في عملياتها. هذا الوضع الصارم يجبر العديد من الشركاء على التخلي عن تقنيات (Claude) فوراً للحفاظ على عقودهم الحكومية المربحة.

الاستخدامات العسكرية السابقة لنموذج كلود

كانت أدوات الشركة مدمجة بشكل عميق في العمليات العسكرية، حيث يُعد نموذجها الأول الذي تم التصريح باستخدامه في العمليات الاستخباراتية السرية. وتشير التقارير إلى أن الجيش الأمريكي اعتمد على هذه التقنيات في حملات عسكرية حساسة، بما في ذلك العملية التي استهدفت المرشد الإيراني علي خامنئي، وذلك قبل ساعات فقط من إعلان وزير الدفاع قرار التصنيف الجديد.

في الختام، تسلط قضية أنثروبيك الضوء على الفجوة الكبيرة بين وتيرة نشر أنظمة الذكاء الاصطناعي وتطور الأطر القانونية والأخلاقية المصممة لحوكمتها. وكما يوضح تقرير تيكبامين، فإن هذه المواجهة المعقدة قد ترسم ملامح جديدة لمستقبل العلاقة بين شركات وادي السيليكون والمؤسسات العسكرية.